O erro mais comum em projetos de IA não é escolher o modelo errado. É não desenhar o verificador. A empresa coloca um agente para ler dados, gerar uma resposta, talvez executar uma ação, e chama isso de automação. Mas ninguém confirma se a ação mudou o estado certo, se a regra foi respeitada, se o resultado ficou auditável, ou se o sistema sabe desfazer o que fez. Isso não é operação inteligente. É confiança falsa em escala.

Durante dois anos, a conversa pública sobre IA ficou presa na pergunta errada: qual modelo usar. GPT, Claude, Gemini, Llama, DeepSeek, Qwen. A cada semana, um benchmark novo. A cada semana, uma janela de contexto maior. A cada semana, alguém dizendo que agora sim a empresa pode automatizar tudo.

Mas modelo melhor não corrige operação sem contrato. Um modelo mais inteligente continua errando quando não sabe qual é a fonte da verdade. Continua alucinando quando a regra está espalhada em planilha, PDF, WhatsApp e memória de funcionário. Continua perigoso quando consegue executar ação sem deixar rastro. Continua caro quando precisa redescobrir o contexto a cada chamada.

O problema nunca foi só inteligência. Foi fechamento de ciclo.

O ciclo aberto é onde a automação quebra

A maioria das automações com IA segue um padrão frágil:

- Recebe uma entrada.

- Consulta algum contexto.

- Gera uma resposta.

- Talvez chama uma ferramenta.

- Termina.

Parece suficiente em uma demo. Não é suficiente em produção.

Produção não pergunta apenas se o agente respondeu. Produção pergunta se a resposta estava ancorada no dado certo. Se a ação respeitou permissão. Se o objeto certo foi alterado. Se a alteração ficou registrada. Se outro sistema consegue ler esse novo estado. Se existe alerta quando algo sai do contrato. Se alguém consegue auditar a decisão três meses depois.

Sem isso, você não tem automação. Você tem um funcionário sintético sem supervisão operacional.

O ciclo fechado é diferente:

- Dado entra, com origem, formato e dono claros.

- Lógica decide, com regra explícita e contexto controlado.

- Ação muda estado, em um objeto real do negócio.

- Verificador confirma, comparando resultado esperado contra resultado observado.

- Rastro fica salvo, para auditoria, aprendizado e correção.

Esse quinto passo muda tudo. O agente deixa de ser uma caixa de texto que parece inteligente e vira parte de um sistema operacional.

Verificador não é teste unitário bonito

Quando falo em verificador, não estou falando de um teste técnico isolado rodando no CI. Isso ajuda, mas é pouco.

Verificador é uma peça operacional. Ele responde uma pergunta simples: depois que a IA agiu, o mundo ficou do jeito que deveria ficar?

Em uma clínica, isso significa conferir se a sessão mudou de status, se o comprovante foi capturado, se a guia foi vinculada ao paciente correto, se a psicóloga certa manteve acesso ao que deve acessar, e se o administrador não atravessou o sigilo do prontuário.

Em uma operação financeira, significa conferir se a posição importada não foi sobrescrita, se o cálculo foi feito sobre a fonte correta, se a recomendação ficou separada do dado bruto, e se a revisão humana foi registrada antes de qualquer decisão sensível.

Em uma redação, significa conferir se a notícia foi triada, se o editor responsável foi atribuído, se o status mudou, se o histórico editorial preservou quem decidiu o quê, e se o sistema não confundiu sugestão com publicação.

Perceba o padrão. O verificador não pergunta se o texto ficou bonito. Pergunta se o estado do negócio ficou correto.

A diferença entre chatbot e cockpit operacional

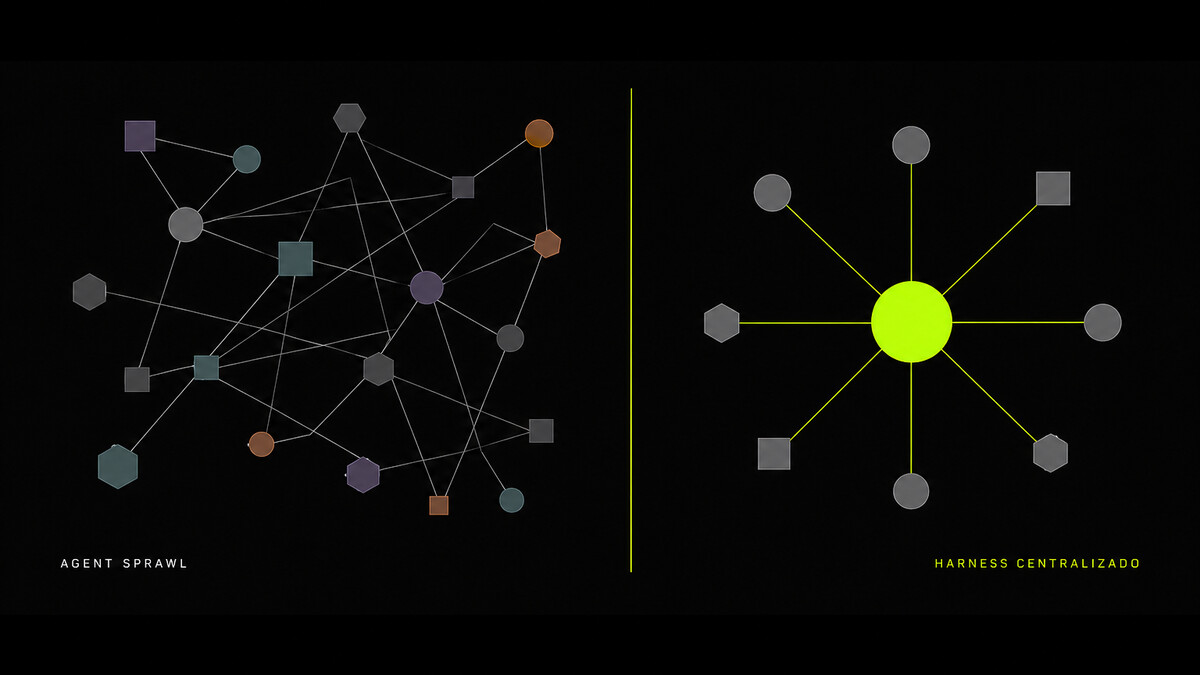

Esse é o ponto onde muita empresa se perde. Ela compra um chatbot e espera que ele resolva um fluxo. Mas fluxo não mora no chat. Fluxo mora na relação entre objetos, regras e ações.

Um chatbot responde. Um cockpit operacional muda estado.

No chatbot, o usuário pergunta: “quem deve cuidar desse caso?” O modelo responde com um nome. A conversa termina. Talvez alguém copie a resposta para outro sistema. Talvez não.

No cockpit, o usuário seleciona o caso, clica em “atribuir responsável”, a ação muda o objeto, o audit log registra o operador, o verificador confirma que o responsável agora existe, e a próxima tela já nasce com o novo estado. O modelo pode ajudar a sugerir. Mas a mudança acontece dentro de um contrato.

É aqui que a Ontologia Operacional entra.

A ontologia define os substantivos do negócio: paciente, sessão, guia, notícia, lead, contrato, posição, pedido. Define as regras que governam esses objetos. Define as ações permitidas. E define o que precisa ser verificado depois que uma ação acontece.

Sem ontologia, o agente improvisa. Com ontologia, o agente opera.

O erro de medir só resposta

Grande parte da avaliação de IA ainda mede a camada errada. Mede se a resposta parece correta. Mede fluência. Mede aderência ao prompt. Mede se o modelo citou a fonte. Isso é útil, mas é incompleto.

Uma IA empresarial precisa ser medida pelo efeito operacional.

Ela reduziu retrabalho? Diminuiu erro? Fechou pendência? Atualizou o objeto certo? Preservou permissão? Deixou rastro? Acelerou uma decisão sem apagar responsabilidade humana?

Essas perguntas não cabem em um benchmark genérico. Elas precisam nascer da operação real. Por isso o verificador não pode ser genérico. Ele precisa ser desenhado junto com a ontologia do negócio.

O erro não é usar IA generativa. O erro é tratar saída textual como sinônimo de trabalho concluído.

O padrão que escala

Um padrão robusto tem cinco camadas:

- Fonte preservada. O dado bruto não é destruído nem editado por conveniência.

- Objeto publicado. O negócio ganha uma representação limpa e operável.

- Ação governada. Toda mudança de estado passa por contrato, permissão e parâmetro explícito.

- Verificador específico. Cada ação crítica tem uma checagem própria.

- Lineage auditável. Qualquer pessoa consegue ver de onde veio, o que mudou, quem mudou e por quê.

Esse padrão parece burocrático até você ver o custo de não ter ele.

Sem fonte preservada, ninguém sabe se o erro veio do dado original ou da transformação. Sem objeto publicado, cada agente cria sua própria versão da realidade. Sem ação governada, a IA vira operador com permissão demais. Sem verificador, erro vira confiança. Sem lineage, ninguém aprende com o erro.

Governança não é freio. É o que permite acelerar sem quebrar a empresa.

O que muda na prática

Quando uma empresa desenha verificadores, a conversa muda.

Antes: “podemos colocar IA nesse processo?”

Depois: “qual estado essa IA tem permissão para alterar, e como vamos confirmar que alterou corretamente?”

Antes: “qual prompt resolve isso?”

Depois: “qual objeto, qual regra, qual ação, qual verificador?”

Antes: “o modelo acertou?”

Depois: “o sistema ficou em um estado melhor, mais correto e mais auditável?”

Essa mudança parece pequena. Não é. Ela separa experimentação de operação.

O diagnóstico em cinco perguntas

Se sua empresa já usa IA em processos reais, faça este diagnóstico:

- Quais ações a IA pode executar hoje? Se a resposta for vaga, o risco está escondido.

- Onde o estado muda depois da ação? Se muda em conversa, email ou planilha manual, o ciclo está aberto.

- Quem verifica o resultado? Se a resposta for “alguém confere depois”, você tem operação humana mascarada de automação.

- O que acontece quando a IA erra? Se não existe log, reversão ou alerta, o erro vira silêncio.

- Como você prova que o processo melhorou? Se não há métrica operacional, só há sensação de produtividade.

Duas respostas fracas já bastam para mostrar que o sistema ainda não está pronto para escalar.

O próximo moat é verificabilidade

Modelos vão continuar melhorando. Custos vão continuar caindo. Contextos vão continuar crescendo. Tudo isso importa. Nada disso substitui arquitetura.

A vantagem competitiva não estará em usar o modelo mais novo antes dos outros. Estará em ter uma operação que consegue incorporar qualquer modelo sem perder coerência, permissão, rastro e capacidade de correção.

O moat não é o prompt. Não é o chatbot. Não é o provedor. O moat é a capacidade de transformar inteligência em ação verificável.

IA sem verificador escala erro com aparência de certeza.

IA com verificador vira sistema.

Se sua empresa já usa IA, mas ainda depende de conferência manual para confiar no resultado, o problema não é o modelo. É a arquitetura. A FSTech desenha ontologias operacionais para transformar automação solta em sistema verificável. Comece pelo framework em fstech.digital/framework.